TOIMITUSJOHTAJA SOITTI YRITYKSEN talouspäällikölle ja pyysi tekemään yllättävän tilisiirron. Tämä kummeksui, aprikoi, eikä lopulta tehnyt työtä käskettyä. Kävi ilmi, että rikolliset olivat generoineet toimitusjohtajan aidolta kuulostaneen äänen tekoälyohjelmalla.

Tuossa yksi Kyberturvallisuuskeskukseen tullut ilmoitus syväväärennöksistä. Viime vuoden toinen tapaus koski politiikassa mukana olevaa henkilöä, joka puhui videolla asioita, joita ei ollut todellisuudessa koskaan lausunut.

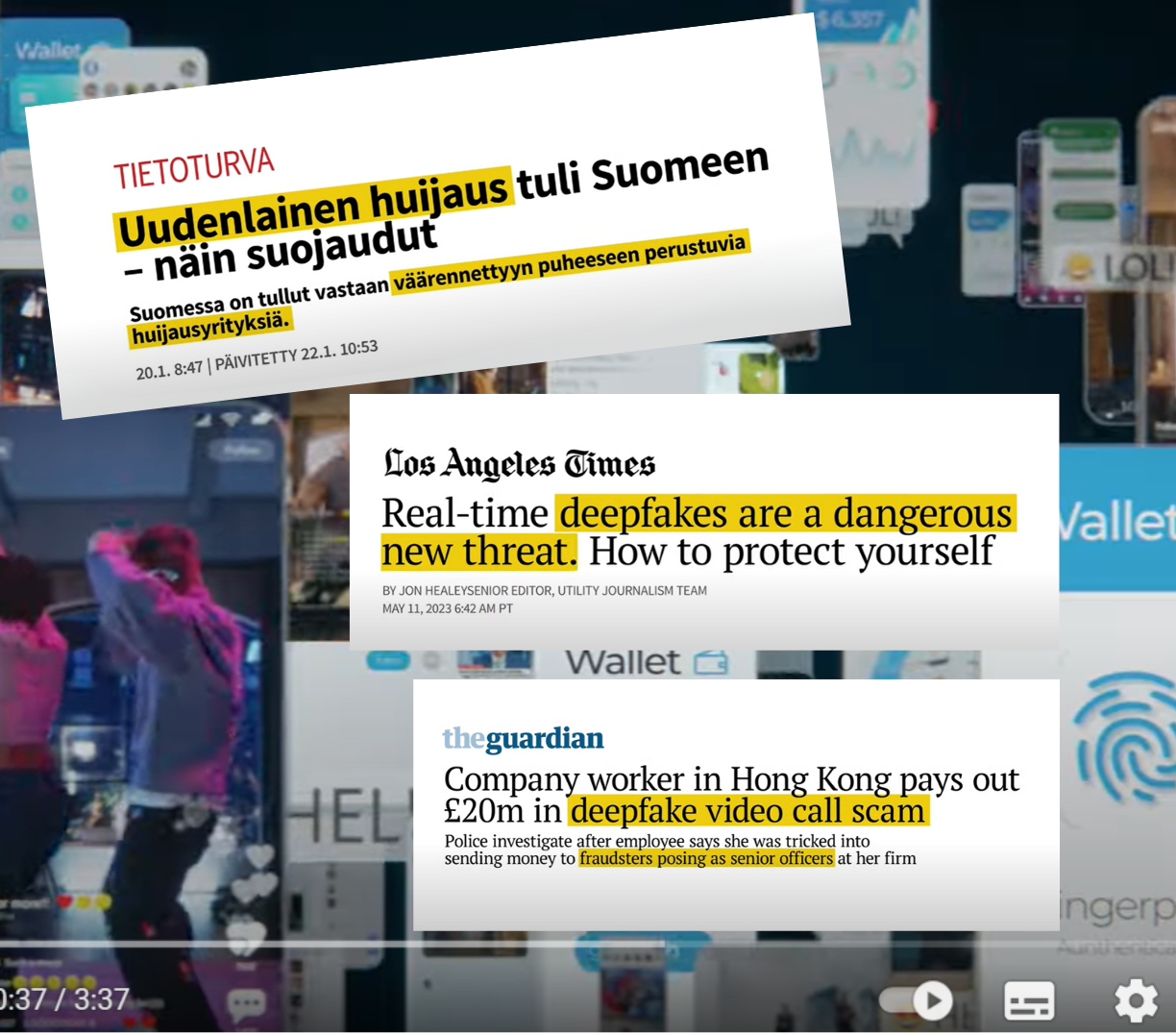

Liikenne- ja viestintäviraston Kyberturvallisuuskeskuksen erityisasiantuntija Aino Sirola kertoo, että deepfaket eli tekoälyn avulla luodut kuvan, äänen tai videon syväväärennökset eivät työllistä keskusta vielä paljoa. Yrityksillä tai yksityishenkilöillä ei ole niihin liittyvää ilmoitusvelvollisuutta ja moni tapaus jäänee kertomatta. Arkielämässämme deepfakeihin törmää kuitenkin yhä useammin.

– Erilaisia ohjelmia, joilla voi valmistaa aidolta näyttäviä kuvia ja ääniä on tarjolla paljon ja ne ovat hyvin helppokäyttöisiä. Työkaluja, joilla voi vaihtaa henkilöiden kasvoja toisiksi, löytyy vaikkapa somesta. Tuollaisia ohjelmia voi käyttää viattomaan pilailuun, mutta valitettavasti myös ikävämpiin tarkoituksiin, Sirola mainitsee

Maailmalta on uutisoitu esimerkiksi tapauksista, joissa isovanhemmilta on yritetty saada rahaa puheluilla, joissa on käytetty tekoälyn avulla luotua lapsenlapsen ääntä. Poliittisessa propagandassa ja disinformaatiossa syväväärennöksiä käytetään yhä enemmän, yleensä vastapuolen mustamaalaamiseen. Deepfake-pornossa kenen tahansa kasvot voidaan yhdistää jonkun toisen alastomaan vartaloon, tavallisesti häväistystarkoituksessa.

Deepfake-videot kuuluvat arsenaaliin myös esimerkiksi Gazan sodassa sekä Venäjän aloittamassa hyökkäyssodassa Ukrainaa vastaan. Jo sodan alkuvaiheissa esiin nousi syväväärennetty video, jossa presidentti Volodymyr Zelenskyi kehotti ukrainalaisia antautumaan. Videon teettäjää ei ole kovin vaikea arvata. (Ks. mm. Associated Press / apnews.com 3.11.23.)

PARAS ASE DEEPFAKEJA vastaan on kriittisyys ja medialukutaito, muistuttaa Aino Sirola.

– Kannattaa esimerkiksi muistaa, että viestiin on aina jokin syy. Mieti, kuka viestin jakaa, missä, miksi ja mitä hän yrittää mahdollisesti saavuttaa.

Journalistisia periaatteita noudattavassa, lähteensä huolellisesti tarkistavassa mediassa syväväärennöksiin törmää harvoin. Mikäli tällainen media erehtyy pitämään väärennöstä aitoina, se oikaisee virheensä.

Syväväärennöksiä kohtaa todennäköisemmin netissä, sosiaalisessa mediassa ja erityisesti erilaisilla disinformaatiota ja salaliittoteorioita jakavilla sivustoilla, missä niitä käytetään yleensä tarkoituksella. Usein tällaiset sivustot yrittävät naamioitua oikeiksi uutissivustoiksi ja jäljittelevät niitä esimerkiksi ulkoasultaan ja nimeltään.

Mikäli viesti kuulostaa yllättävältä, uskomattomalta – tai vaikkapa liian hyvältä ollakseen totta – se ei yleensä ole totta. Tieto kannattaa vähintäänkin tarkistaa useammasta eri lähteestä.

SYVÄVÄÄRENNÖKSET KEHITTYVÄT KOKO ajan taitavammiksi. Aivan kaikki ei tekoälyltäkään kuitenkaan vielä onnistu.

– Kuvissa kannattaa kiinnittää huomiota kokonaisuuteen, mutta myös erilaisiin kriittisiin yksityiskohtiin. Katso, ovatko esimerkiksi varjot ja heijastumat oikein ja näyttääkö iho luonnolliselta. Tekoälyllä on usein vaikeuksia myös käsien asentojen, sormien, silmien ja nenänpäiden kanssa, Sirola kertoo.

Tekoälyllä saattaa olla sormensa pelissä myös silloin, jos puhe vaikuttaa rytmiltään kummalliselta tai monotoniselta. Lisäksi videoissa on hyvä tarkkailla huulten ja äänen yhteispeliä. Siltä varalta, että joku saa tutultaan oudolta tuntuvan puhelun, Sirolalla on spesiaalivinkki:

– Kysy soittajalta jotain, mihin vain sinä ja aito henkilö tiedätte. Kysy vaikkapa, mikä henkilön lempinimi oli lapsena tai mistä eilisessä kokouksessa puhuttiin.

MYÖS FACEBOOK-TILEJÄ VOIDAAN kaapata ja henkilön Facebook-kavereita lähestyä, osittain syväväärennöksiäkin hyödyntäen.

– Mikäli epäilet, että on kyse identiteettivarkaudesta, niin ota asianosaiseen henkilöön yhteys jollakin toisella välineellä. Soita vaikkapa puhelimella, ja varmista, että viestit ovat todellakin tulleet häneltä.

Tilikaappaukset ja muut someongelmat pitää antaa ilmi kyseisen somepalvelun tarjoajalle. Somealustoilla on myös omia järjestelmiä, joilla ne pyrkivät, vaihtelevalla menestyksellä, estämään erilaisia huijauksia sekä moderoimaan sisältöään ja lisäämään julkaisuihin merkintöjä niiden virheellisestä faktasisällöstä.

Käytännössä myös tekoäly on opetettu taistelemaan tekoälyllä luotuja syväväärennöksiä vastaan ja erottamaan epäaidon aidosta. Vertailukohtia löytyy helposti muualta kyberturvallisuudesta: kun toiset yrittävät koko ajan luoda haittaohjelmia tai löytää verkosta teknisiä haavoituksia, toiset yrittävät kehittää näitä vastaan suojamekanismeja.

SYVÄVÄÄRENNÖSTEN MÄÄRÄ LISÄÄNTYY. Pessimisti saattaisi pohtia, että olemme siirtymässä maailmaan, missä kukaan ei voi enää luottaa näkemäänsä.

– Paniikkiin ei ole syytä. Mutta on tärkeää, että niin organisaatiot kuin yksilötkin tunnistavat uuden ilmiön. Tällöin opimme myös tulemaan sen kanssa toimeen, erityisasiantuntija Sirola sanoo.

Kyberturvallisuuskeskus on kehottanut jokaista kiinnittämään huomioita myös esimerkiksi omaan digitaaliseen jalanjälkeensä eli siihen, minkälaisia merkkejä ja syväväärennöksiin kelpaavaa materiaalia verkkoon jätämme. Tämä koskee myös läheisiämme, lapsillakin on oikeus omaan yksityisyyteensä.

Lisää aiheesta:

Liikenne- ja viestintävirasto Traficomin Kyberturvallisuuskeskuksen tuottama YouTube-video Kun jokainen päivä voi olla aprillipäivä – Mistä deepfakeissa on kysymys?

Minkälaista on tekoälyn luoma ääni? Osviittaa antavat Youtubesta ja Tiktokista löytyvät Pressat pelaa -videot. Vaikka videot ovat satiirisia, niiden tekijät ovat saaneet palautetta myös ihmisiltä, jotka ovat luulleet, että äänessä ovat aidot presidentinvaalien ehdokkaat (HS 3.4.2024).

Tekoälyn avulla on myös käsitelty tunnettujen artistien ääntä ja laitettu heidät esittämään kappaleita, joita he eivät ole todellisuudessa koskaan esittäneet. Youtubesta voi katsoa esimerkiksi, miten jo edesmenneeltä Johnny Cashilta sujuu kappale Barbie Girl. Monet artistit Billie Eilishista Stevie Wonderiin ovat vaatineet suojaa tällaista tekoälyn käyttöä vastaan.